Projeto combate a desinformação contra LGBTQIA+ na Wikipédia

Força-tarefa liderada pela Acontece - Arte e política LGBTI+ revisou e corrigiu mais 300 verbetes. Para grupo, informações falsas reforçam estigmas e estimulam violência

Rafael Ciscati

5 min

Navegue por tópicos

Tempos atrás, quem pesquisasse por “travestis e transexuais” na Wikipédia, maior enciclopédia online do mundo, depararia com uma informação falsa.

O artigo sobre o assunto, lembra a psicóloga Pietra Fraga, incluía uma “escala de intensidade” segundo a qual algumas pessoas poderiam ser mais ou menos trans. Uma ideia absurda. “Era não apenas ofensiva, como carregava uma carga extremamente patologizante e hierarquizante”, afirma a psicóloga, coordenadora de projetos da ong Acontece — Arte e Política LGBTI+. Fenômeno parecido ocorria com outros verbetes que versavam sobre a população LGBTQIA+. Em muitos casos, se a informação não era falsa, era imprecisa ou cheia de lacunas.

Pensada como um imenso projeto colaborativo, a Wikipédia permite que usuários criem e editem verbetes. A promessa — ou esperança— é de que essa rede de editores revise o próprio trabalho e, aos poucos, corrija erros. Quando se trata de informações sobre grupos minorizados, no entanto, esse processo espontâneo de autocorreção pode ser moroso.

Ao longo do último ano, Pietra e a equipe da Acontece trabalharam para tornar esse processo mais sistemático. Em parceria com o Observatório de Mortes e Violências contra LGBTI+ (que Pietra também coordena) o grupo criou uma força-tarefa que revisou 302 verbetes relacionados à população LGBTQIA+. Desse total, 40% continham erros ou imprecisões. A equipe ainda criou, corrigiu ou aprimorou nove verbetes. Os resultados desse esforço de checagem foram divulgados no dia 17 de maio, Dia Internacional da Luta contra a LGBTfobia. A iniciativa contou com o apoio do projeto Mais Teoria da História na Wiki.

>>Leia também: É possível prevenir violência contra LGBTQIA+, mas falta compromisso do Estado

A empreitada, conta Pietra, surgiu a partir de um convite feito pela ONU Direitos Humanos. Em maio do ano passado, a agência internacional manifestou o desejo de criar mecanismos para combater a desinformação contra o público LGBTQIA+ online. “A proposta era transformar a Wikipédia em um território mais seguro, justo e representativo para essas pessoas”, diz a psicóloga.

A análise feita pela força-tarefa deu pistas de como a desinformação circula pela web. Muitas vezes, a informação falsa vem escamoteada em um artigo aparentemente correto. “Dos 302 verbetes analisados, somente 16 tinham conteúdo explicitamente discriminatório”, diz Pietra. “Considerando o histórico do país em relação à LGBTfobia e o perfil majoritariamente masculino dos redatores da Wikipédia, esperávamos uma incidência maior”. Já outros 102 artigos foram classificados como “incompletos ou desqualificados”. Um sinal, diz a psicóloga, de que falta ocupar esse espaço com informação de qualidade.

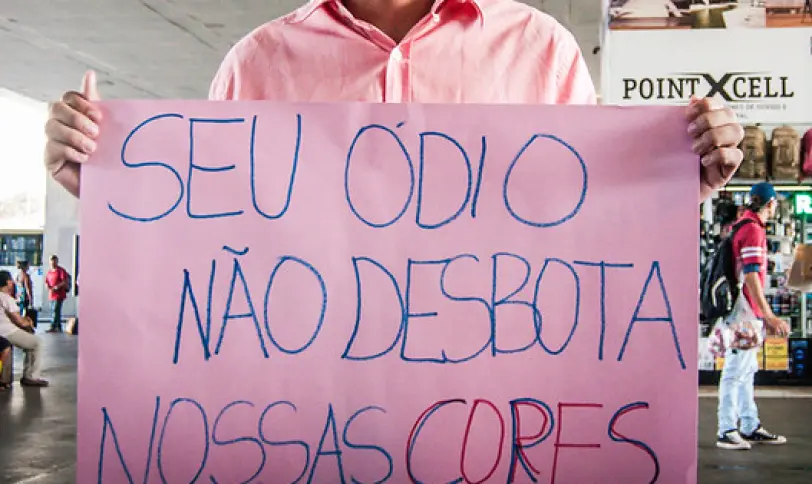

A questão importa porque a desinformação que circula na rede influencia comportamentos no mundo real. “Conteúdos preconceituosos ou incompletos, hoje, podem influenciar estigmas amanhã”, diz Pietra.

Ela fala do tema com propriedade: desde 2021, a Acontece LGBTQIA+ publica o Dossiê de Mortes e Violências contra LGBTI+ no Brasil. O trabalho é realizado em parceria com a Associação Nacional de Travestis e Transexuais (Antra), e a Associação Brasileira de Gays, Lésbicas e Transexuais (ABGLT). Situa o país numa lista que preocupa: ano sim, outro também, despontamos entre aqueles que mais matam pessoas LGBTQIA+ em todo o mundo (considerando, aqui, o grupo de países em que existem levantamentos sobre esse tipo de violência).

A própria Wikipedia sabe disso e vem travando uma briga contra a propagação de notícias falsas. Ao longo dos anos, criou protocolos que restringem a edição de artigos delicados (como aqueles que falam sobre líderes políticos em evidência) a editores mais experientes. E, tempos atrás, chegou a manifestar o desejo de criar um site de notícias próprio. Mas sempre se valeu, sobretudo, do conhecimento das massas: a capacidade da comunidade de editores de identificar e reparar erros.

Hoje, a Wikimedia Foundation, que mantém a enciclopédia, informa que mais de 1,8 bilhão de aparelhos acessem os artigos da Wikipédia todos os meses (eles não divulgam números de visitantes únicos). O alcance potencial das informações disponibilizadas no site, no entanto, é muito maior: mais recentemente, a Wikipédia se converteu em um imenso repositório de dados usados para treinar algoritmos de inteligência artificial. “As informações da Wikipedia vão moldar decisões automatizadas em diversas áreas: educação, segurança, saúde, e até políticas públicas” diz Pietra. “Corrigir essas distorções é uma medida urgente de justiça informacional e de proteção coletiva”.

Além de corrigir erros em artigos já existentes, o grupo escreveu alguns verbetes em português. A intenção, diz Pietra, era tornar acessível conhecimento útil acerca de temas importantes para a comunidade LGBTQIA+. Os novos artigos falam sobre cotas para pessoas trans, discrinação algorítmica, criminologia queer, entre outros temas. “A ideia era garantir não apenas volume, mas profundidade e representatividade nos conteúdos criados”, diz Pietra. “A ausência de conteúdo de qualidade é também uma forma de violência simbólica”.

Você vai gostar também:

Cis e trans: qual a diferença dos termos?

3 min

Saiba o que pode e o que não pode em uma abordagem policial

16 min

Rafael Ciscati

ECA: o que é o Estatuto da Criança e do Adolescente

7 min

Entrevista

Ver mais

COP30: “A Conferência das Partes precisa ouvir a parte do povo”

6 min

Angela RoRo: relembre a entrevista histórica da cantora ao Chanacomchana

11 min

Glossário

Ver mais

O que é adaptação climática e por que ela importa

5 min

Povos e comunidades tradicionais: entenda o que são

14 min